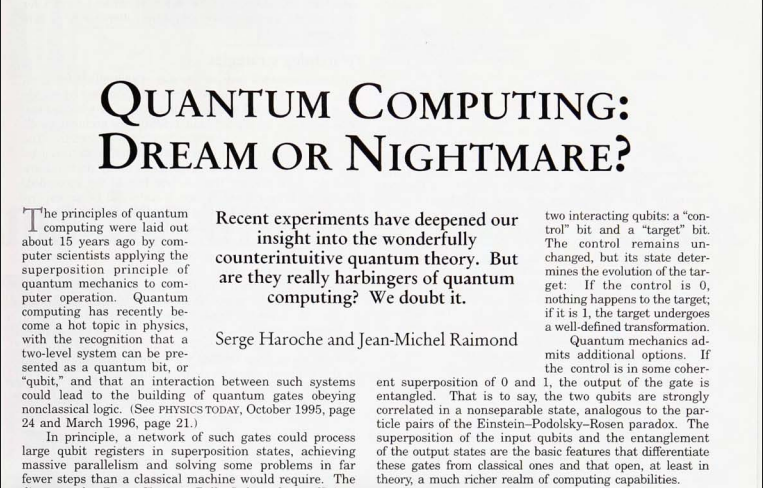

Bu metin, Serge Haroche ve Jean-Michel Raimond tarafından kaleme alınan ve Physics Today dergisinde 1996 yılında yayımlanan “Quantum Computing: Dream or Nightmare?” başlıklı makalenin Türkçe çevirisidir. Yazarlar, kuantum hesaplamanın teorik olanaklarını kabul etmekle birlikte, büyük ölçekli kuantum bilgisayarların pratikte karşılaşacağı temel fiziksel ve mühendislik engellerine dikkat çekerek bu teknolojinin uygulanabilirliğine eleştirel bir perspektif sunmaktadır.

Kuantum Hesaplama: Hayal mi Kâbus mu?

Kuantum hesaplamanın ilkeleri yaklaşık 15 yıl önce, bilgisayar bilimcilerin kuantum mekaniğinin süperpozisyon ilkesini bilgisayar işlemlerine uygulamasıyla ortaya konmuştur. Kuantum hesaplama, iki seviyeli bir sistemin bir kuantum biti ya da “kübit” olarak temsil edilebileceğinin ve bu tür sistemler arasındaki bir etkileşimin klasik olmayan mantığa uyan kuantum kapılarının kurulmasına yol açabileceğinin anlaşılmasıyla son zamanlarda fizikte önemli bir konu haline gelmiştir.

İlke olarak, bu tür kapılardan oluşan bir ağ, süperpozisyon durumlarındaki büyük kübit kayıtlarını işleyebilir, büyük ölçüde paralellik sağlayabilir ve bazı problemleri klasik bir makinenin gerektireceğinden çok daha az adımda çözebilir. Bell Labs’ta Peter Shor tarafından ideal bir kuantum makine için verimli bir sayı çarpanlara ayırma algoritmasının keşfi, bu alana önemli ölçüde ilgi doğurmuştur. Çarpanlara ayırma problemi mevcut bilgisayarlarda çözülmesi o kadar zordur ki güvenli şifreleme için yaygın olarak kullanılmaktadır. Daha hızlı çarpanlara ayırma yaparak kuantum bilgisayarlar mevcut şifreleme sistemlerini geçersiz hale getirecektir.

Bu aşamada, büyük bir heyecanın kaynadığı bu alanda bazı eleştirel değerlendirmelerin gerekli olduğunu düşünüyoruz. Bu coşkunun kesinlikle haklı olduğunu düşünüyoruz, ancak genellikle ileri sürülen nedenlerden dolayı değil. Kuantum hesaplama fikri, yalnızca daha hızlı hesaplama yapma gibi görece sıradan bir problemin çok ötesine geçen büyüleyici yeni bir fizik içerse de, büyük ölçekli hesaplamaların öngörülebilir gelecek için imkânsız bir hayal olarak kalacağına inanıyoruz.

Bununla birlikte, basit kapı işlemleri ve birkaç kübitin dolanıklığını inceleme sürecinde fizikçiler, klasik ve kuantum dünyaları arasındaki zor yakalanan sınır hakkında çok şey öğrenecek ve kuantum mekaniğinin kurucularının yarım yüzyıldan daha uzun bir süre önce ortaya attığı en derin sorunların bazılarını ele alacaktır. Bu araştırma, bilgisayar bilimciler tarafından ortaya konan kavramlardan büyük ölçüde yararlanır ve böylece matematik ile fizik arasındaki disiplinlerarası etkileşimin çarpıcı bir örneğini sunar. Aynı zamanda, hâlihazırda çok sayıda aşırı iyimser öngörünün yapıldığı bir alanda, pratik uygulamalara ilişkin gerçekçi olmayan vaatlerin tehlikelerine karşı bir uyarı yapma gereği duyuyoruz. Bir zamanlar optik bilgisayarlar ve Josephson bilgisayarları için beslenen büyük umutlar hatırlanabilir.

İdeal bir kuantum bilgisayarın temel yapı taşı, iki etkileşen kübitten oluşan bir kapıdır: bir “kontrol” biti ve bir “hedef” biti. Kontrol değişmeden kalır, ancak durumu hedefin evrimini belirler: Eğer kontrol 0 ise hedefte hiçbir şey olmaz; eğer 1 ise hedef belirli bir dönüşüme uğrar. Kuantum mekaniği ek seçeneklere izin verir. Eğer kontrol, 0 ve 1’in koherent bir süperpozisyonundaysa, kapının çıktısı dolanık olur. Yani iki kübit, ayrıştırılamayan bir durumda güçlü biçimde koreledir; bu durum Einstein-Podolsky-Rosen paradoksundaki parçacık çiftlerine benzer. Giriş kübitlerinin süperpozisyonu ve çıkış durumlarının dolanıklığı, bu kapıları klasik olanlardan ayıran temel özelliklerdir ve en azından teoride çok daha zengin bir hesaplama yetenekleri alanı açar.

Son Deneyler

Tuzaklanmış iyonlarla ya da küçük boşluklarda bulunan atomlar ve fotonlarla yapılan çeşitli son deneyler, bir kuantum kapı için gerekli tüm bileşenleri göstermiştir. Atomik ya da alan durumları iki seviyeli sistemler olarak şematize edilebilir. Bunları etkileşime sokarak temel kübit işlemleri gerçekleştirilebilir. Bu, bize göre, kuantum hesaplama kavramının son zamanlarda bu kadar popüler hale gelmesinin başlıca nedenidir.

Bu nedenle, başlangıçta kuantum teorisinin temel yönlerini test etmek üzere tasarlanmış deneysel düzenekler, son zamanlarda kuantum mantık işlemlerini göstermek için kullanılmıştır. Tek bir kuantum mantık kapısını çalıştırmak temel bir zorluk oluşturmasa da, çok sayıda kapıyı birleştiren büyük ölçekli bir bilgisayarın çalıştırılması söz konusu olduğunda durum dramatik biçimde değişir. Hesaplamanın ilerleyebilmesi için makinenin, klasik olarak alternatif olan çok sayıda yolun kuantum girişimi sonucunda oluşan devasa bir kübit süperpozisyonuna evrilmesi gerekir.

Böyle bir hayal senaryosu, dış dünyadan tamamen izole edilmiş bir makine gerektirir. Ancak gerçekte kuantum koherens, çevreyle kaçınılmaz etkileşimlere karşı son derece hassastır. Bu uyarı pek çok çalışmada zaten vurgulanmıştır. Uyarılmış bir kübit durumunu etkileyen tek bir gevşeme olayı bile hesaplama için gerekli koherensi yok edebilir.

Decoherence probleminin büyüklüğünü anlamamıza basit bir argüman yardımcı olur. Eğer T bir kübitin gevşeme süresi ve t tek bir kapının işlem süresi ise, R = T/t oranı varsayımsal bilgisayar için bir ölçüt görevi görür. Makul bir başarı olasılığıyla hesaplama yapılabilmesi için R’nin, kübit sayısı ile kapı işlemlerinin sayısının çarpımı mertebesinde olması gerekir.

Örneğin, Shor’un çarpanlara ayırma algoritmasının son derece mütevazı bir uygulamasını ele alalım: dört bitlik bir sayının çarpanlara ayrılması. Bu bile yaklaşık 20 kübit üzerinde 20.000 kapı işlemi gerektirir. Dolayısıyla R’nin yaklaşık 400.000’den büyük olması gerekir ki bu, mevcut en iyi kuantum optik sistemler için oldukça iyimser bir değerdir. Daha kullanışlı bir görev—örneğin 400 bitlik bir sayının çarpanlara ayrılması—ele alındığında, R, giriş sayısının boyutunun en azından küpüyle ölçeklendiğinden yaklaşık 4 × 10¹¹ mertebesinde olmalıdır. Eğer t, Boulder’daki Ulusal Standartlar ve Teknoloji Enstitüsü’nde David Wineland’ın grubunun yakın zamanda gösterdiği iyon tuzağı kapısında olduğu gibi milisaniyenin onda biri ise, gevşeme süresinin bir yıl olması gerekir!

Endişeye Gerek Yok mu?

İyimserler, bu tür gereksinimlerin bizi caydırmaması gerektiğini savunur. “Sonuçta Pascal’ın makinesi ile Pentium işlemcisi arasında büyük ilerleme kaydedildi,” derler ve teknoloji ile finansmanın neler yapabileceği konusunda açık bir sınır olmadığını ileri sürerler. Ancak bu görüş, t ve T’nin birbirinden bağımsız olarak ve zıt yönlerde ayarlanabileceği varsayımına dayanır. Oysa bugün bilinen hiçbir sistemde bu doğru değildir. Kübitleri birbirine bağlayan fiziksel etkileşim, kendi gürültüsünü de ekler ve bu da kübitlerde rastgele bozulmalara yol açar.

Örneğin iyon tuzağı kapısında kübitler, bir iyonun temel düzeyinin iki alt durumu içinde kodlanır ve bu durumlar prensipte sonsuz ömürlüdür. Ancak kübit işlemi, iyonun kısa ömürlü uyarılmış bir düzeye sanal geçişini içeren lazerle uyarılmış bir Raman süreci ile gerçekleştirilir. Eğer bu geçişin süresi lazer gücü artırılarak kısaltılırsa, istenmeyen gerçek geçişlerin ve ardından gelen spontan yayımın olasılığı da artar; bu da kübitin kuantum koherensini yok eder. Dolayısıyla t’yi kısaltmak, nihayetinde T’yi de kısaltmadan mümkün değildir.

Lazer gücünden bağımsız olarak, böyle bir iyon tuzağı kapısı için R’nin ince yapı sabitinin ters küpünü, yani yaklaşık 3 × 10⁶ değerini önemli ölçüde aşamayacağı gösterilebilir. Bu sınır, izinli elektrik-dipol optik geçişlere dayanan tüm kapılar için geçerlidir. Dolayısıyla decoherence için herhangi bir düzeltme yapılmazsa, optik bir kuantum bilgisayarın gerçekleştirebileceği en iddialı görev dört bitlik bir sayıyı çarpanlara ayırmak olacaktır.

Başka bir nokta daha belirtilmeye değerdir. Süperiletken metaller ya da yakın zamanda üretilmiş Bose-Einstein atomik yoğunlaşmaları gibi makroskopik kuantum sistemler decoherence ile yok edilmez. Peki o halde kuantum bilgisayarlar neden bu kadar savunmasızdır? Çünkü gerçekten temel bir fark vardır. Makroskopik yoğunlaşmalar, çok sayıda parçacık içerseler bile, bilgi içeriği zorunlu olarak sıfır olan tek bir kuantum durumu ile tanımlanır. Buna karşılık varsayımsal bir kuantum makinede kübitler çok sayıda farklı durumda süperpozisyon halinde bulunabilir. Örneğin 1000 kübitlik bir kayıt 2¹⁰⁰⁰ ≈ 10³⁰⁰ durumu kapsar ve bu durumların tümü arasındaki koherens milyonlarca işlem boyunca korunmak zorundadır. Böyle bir kuantum canavarı yönetmek, Schrödinger’in ünlü kedisini hem ölü hem de canlı durumların süperpozisyonunda tutmaya çalışmak kadar zordur.

Decoherence problemini aşmak için son zamanlarda çeşitli yaratıcı yöntemler önerilmiştir. Bunlar, genel olarak “watchdog” stratejileri olarak özetlenebilir: Spontan yayım süreçleri ölümcül hatalar olduğundan, bunları tespit edelim ve etkilerini düzelterek kuantum koherensini yeniden oluşturalım.

Watchdog Stratejileri

Bu yöntemlerin tümü fazladan bilgi kullanımına dayanır. Tek bir bit yerine, 0 veya 1 bilgisi üç ya da daha fazla kübitten oluşan dolanık durumlarda kodlanır. Böylece bir bit yanlışlıkla değiştiğinde, bu durum hassas bir tespit prosedürüyle fark edilir ve düzeltilir. Bu tür çok parçacıklı dolanık durumların hazırlanmasının son derece zor olduğu ve henüz kimsenin bunu başaramadığı gerçeği bizi caydırmamalıdır. Böyle bir durumun hazırlanması başlı başına deneysel bir ustalık göstergesi olacak ve kuantum mekaniğinin çarpıcı testlerine yol açacaktır.

Ancak bu tür dolanık durumların laboratuvarda yaygın hale geldiği varsayılsa bile, watchdog sisteminin dikkatindeki en küçük bir eksiklik (başka bir deyişle tespit veriminin %100’den düşük olması) koherens kaybına yol açacaktır ve sistemi kontrol etmek için gereken işlem dizilerindeki herhangi bir kusur ek hatalar üretecektir. Bu nedenle, öngörülmeyen yeni bir fizik keşfedilmedikçe, hata düzeltme kodlarının uygulanmasının birkaç kapıdan daha büyük sistemlerde son derece zor olacağını söylemenin makul olduğunu düşünüyoruz.

Bu anlamda, büyük ölçekli kuantum makinesi bilgisayar bilimcisinin hayali olsa da deneycinin kâbusudur.

Büyük ölçekli bir kuantum bilgisayar gerçekçi değilse, birkaç düzine kübitten oluşan küçük bir bilgisayar ne olacaktır? Bu bilgisayarlar kuantum mantığına uydukları için, MIT’den Seth Lloyd bunların, kübit sayısı kadar parçacıktan oluşan bir kuantum spin sisteminin davranışını hesaplamak için özellikle uygun olacağını ileri sürmektedir. Bu, fiziksel bir sistemi, aynı hareket denklemlerine uyan yapay bir kopya ile simüle etmek anlamına gelir.

Biz ise, böyle zorlayıcı bir simülasyon çabasını gerektirecek gerçek spin problemlerinin var olduğundan güçlü biçimde şüphe duyuyoruz. Eğer yalnızca birkaç parçacık söz konusuysa, klasik bilgisayarlar bu işi zaten yapabilir ve kuantum hesaplamaya ihtiyaç ortadan kalkar.

Kuantum hesaplama bir hayal olarak kalsa bile, birkaç kübit düzeyindeki kuantum bilgi işleme fiziği son derece büyüleyicidir. Tuzaklanmış iyonlar ya da boşluklardaki atomlarla yapılan dolanıklık deneyleri, kuantum ölçüm teorisinin temel yönlerini anlamamıza yardımcı olacak ve basit kuantum sistemlerin hassas spektroskopisinde önemli ilerlemelere yol açabilecektir.

Decoherence etkilerini kısmen kontrol etmeye yönelik yeni keşfedilen stratejiler, yakın zamana kadar imkânsız görülen bu alanda, mezoskopik sistemlerdeki enerji kaybını anlamamızı büyük ölçüde ilerletmektedir. Kavramsal olarak basit deneylerde kuantum decoherence’ı test etmek de önemli ve zorlayıcı bir görevdir.

Bu tür deneyler, büyük bir kuantum bilgisayarın nasıl inşa edileceğini öğretmekten ziyade, bunun neden başarısız olacağını anlamamıza daha çok katkı sağlayacaktır. Bu alt alanın gerçekten vaat ettiği şey, fizikçiler tarafından keşfedilmiş en karşı-sezgisel teoriye dair daha derin bir kavrayıştır.

Kaynak eser

- Serge Haroche and Jean-Michel Raimond, “Quantum Computing: Dream or Nightmare?” Physics Today 49, no. 8 (1996): 51–52.